RSS 2024 Oral

7月17日 荷兰 代尔夫特

论文标题:Event-based Visual Inertial Velometer

作者:路修远*,周易*,牛军凯,钟声,沈劭劼 (*共同一作)

度量访问 | 周易教授分享研究思路

本文提出了一种基于事件相机和IMU的无地图视觉-惯性测速仪,通过融合异构数据实现无人机实时线性速度估计,解决了激烈自我运动状态下相机跟踪失败问题。现实实验利用NOKOV度量动作捕捉系统实时监测事件相机的位姿,验证本文方法估计线性速度的准确性。

研究背景

神经形态事件相机以其异步像素和高时间分辨率成为处理高速自我运动下状态估计的理想选择。但现有基于事件的视觉里程计系统常因局部地图更新不及时导致相机姿态跟踪失败,主要难点在于缺乏不依赖环境假设的有效数据关联方法。由于事件相机的数据依赖于运动,这一问题难以用传统视觉技术解决。

研究思路

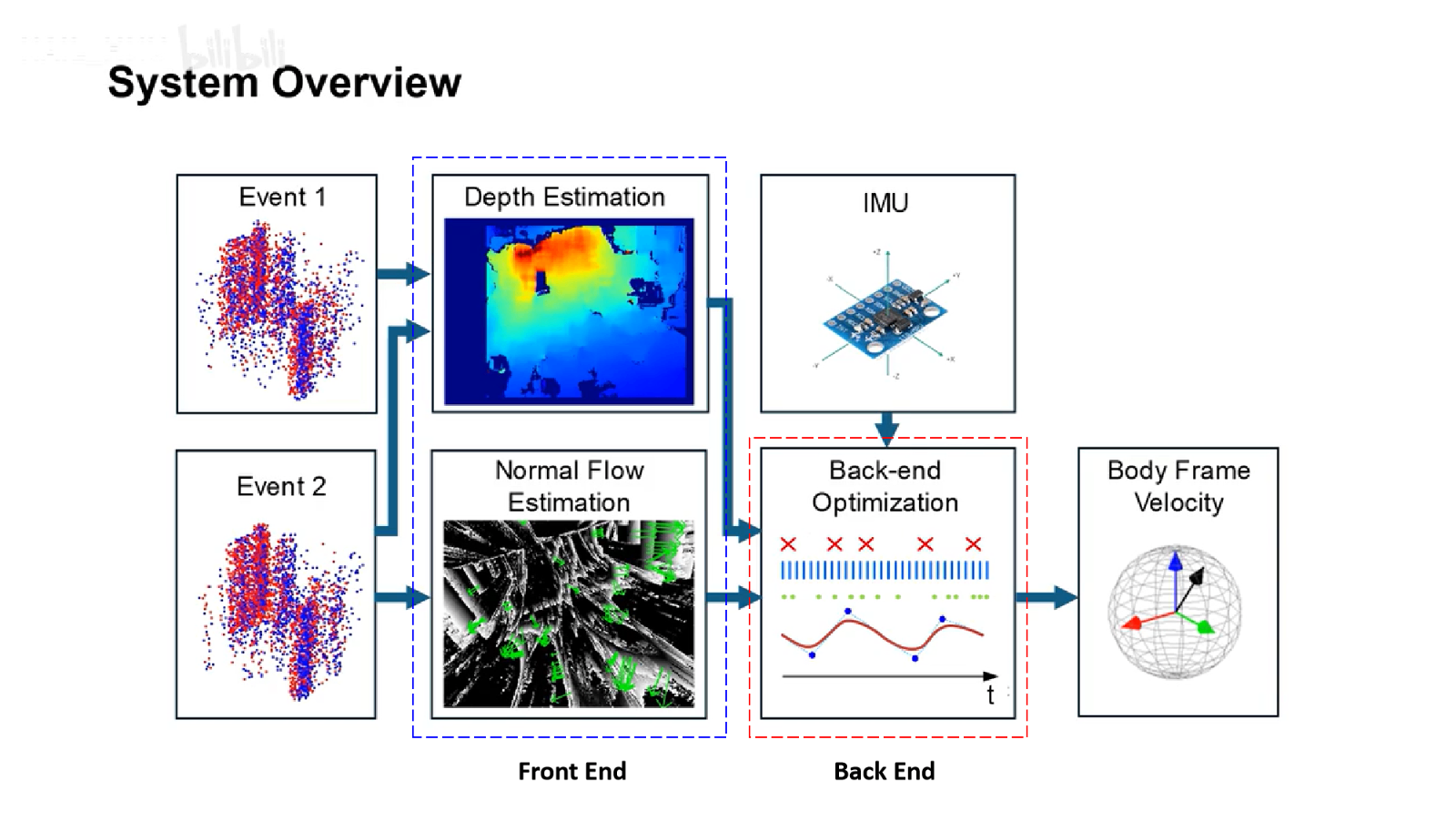

本文提出的基于事件的视觉-惯性测速仪系统的流程

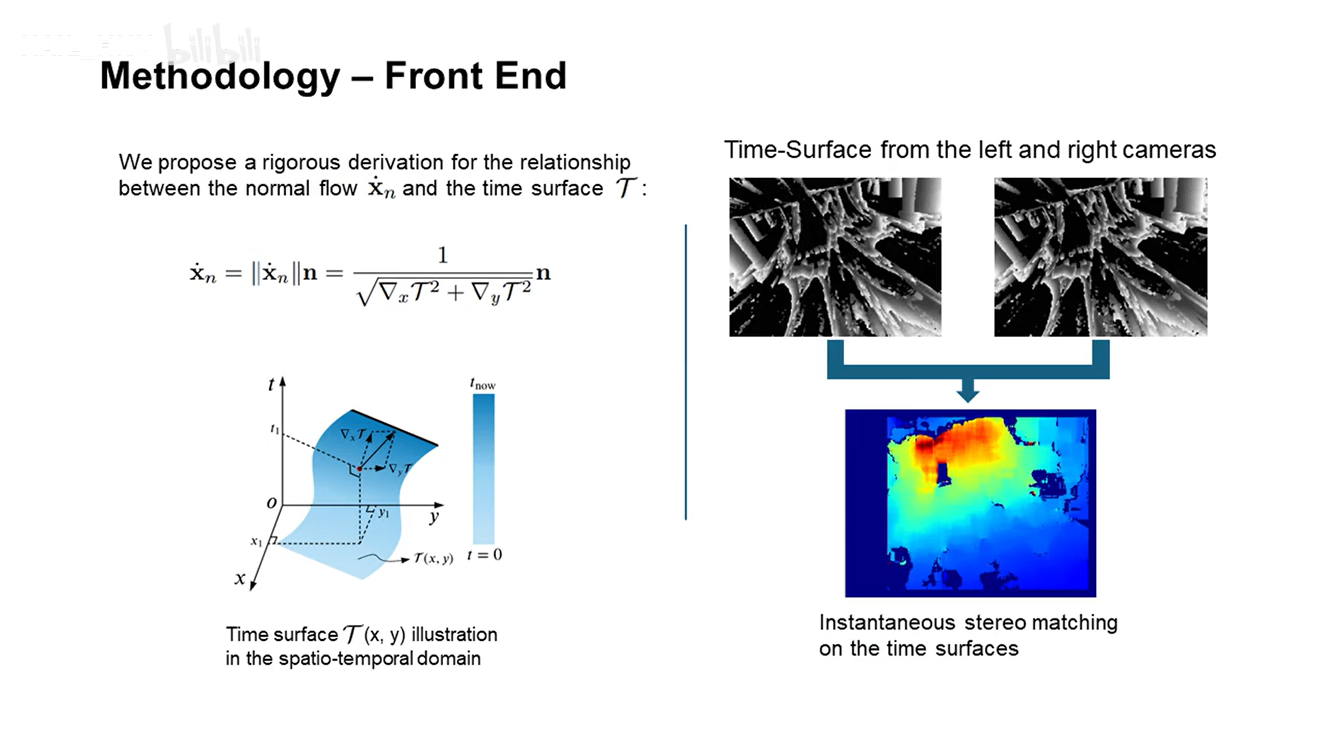

1、前端分别从输入事件中计算法向流和深度信息:本文从事件数据的空间-时间梯度严格推导计算法向流;深度估计应用了即时立体匹配法。

2、后端考虑了事件相机的异步和高数据率特性。本文针对线性速度估计问题提出了一种连续时间流程,它可以处理异步事件测量,并与加速度计在时间上不一致的测量结果建立数据关联。

实验及结果

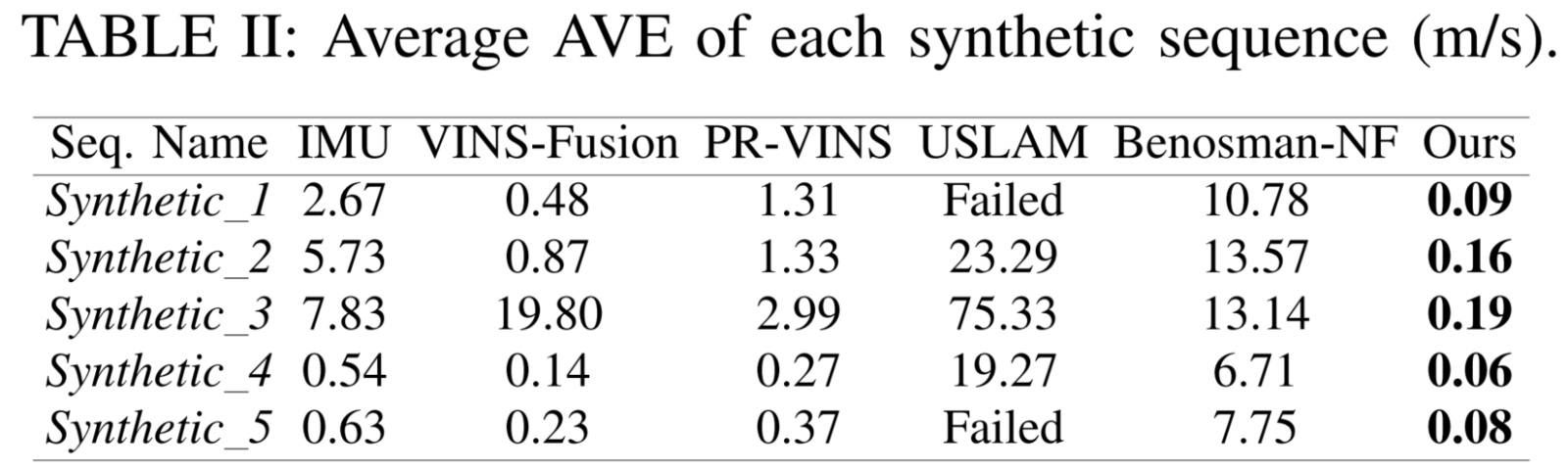

一、仿真实验:

为验证本文方法的有效性,作者使用ESIM模拟器生成了多个序列,模拟无人机在激烈机动下的飞行,并进行比较。这些方法被用来估计线性速度,并使用绝对速度误差(AVE)和相对速度误差(RVE)作为评估指标。

实验结果表明,本文方法在AVE和RVE方面均表现最佳。

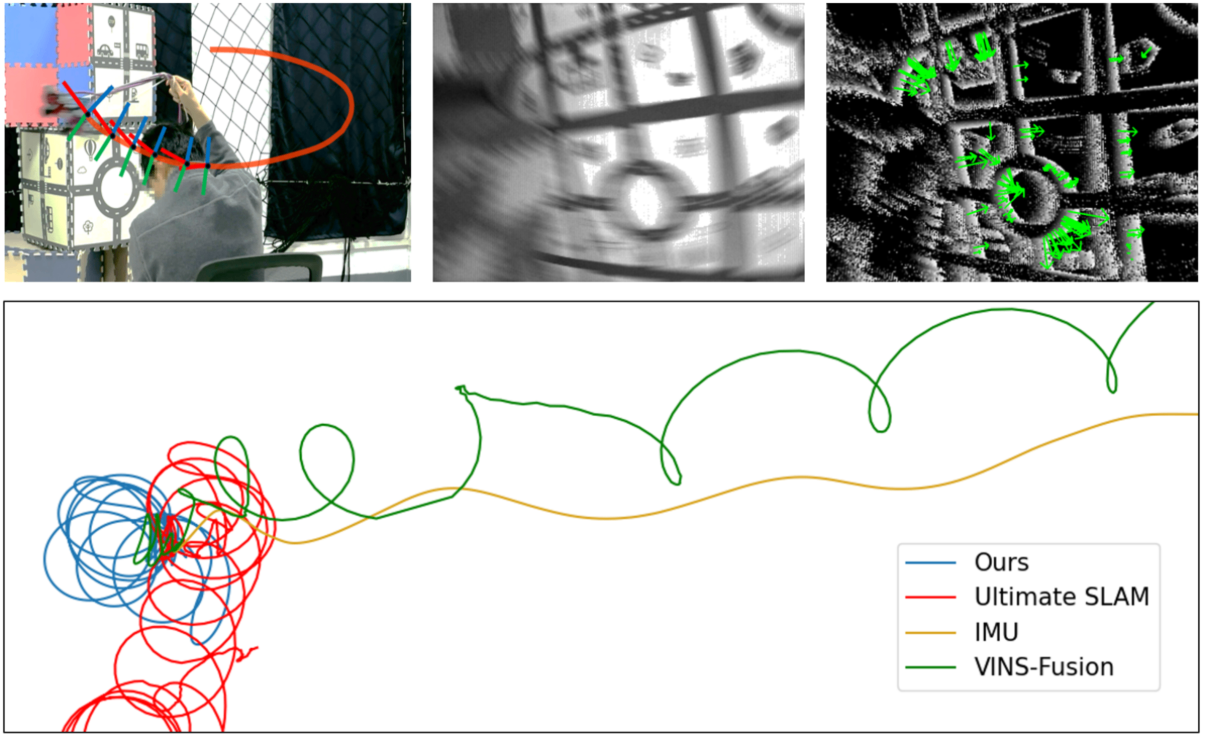

二、现实实验:

作者通过将立体事件相机固定在绳索上并进行旋转,模拟激烈运动。真实实验在9米×6米×3.5米的房间中进行。NOKOV度量动作捕捉系统获取事件相机的精准位姿,能够以200Hz的频率和亚毫米级精度提供六自由度姿态数据,用于验证所提方法的线性速度估计的准确性。

积分得到的轨迹结果对比

实验结果表明,本文提出的方法在真实数据集上也表现出较低的AVE,验证了其在现实世界条件下的有效性。

总结

本文提出的基于事件的视觉-惯性测速仪系统在合成和真实数据集的多序列对比中均显示出优越的性能,特别是在处理激烈运动和复杂动态场景时。实验结果证明了本文提出方法在实时性、准确性和鲁棒性方面的优势。

NOKOV度量动作捕捉系统提供的亚毫米级地面真实数据,作为基准验证了本文方法估计线性速度的准确性。

作者介绍

周易,湖南大学机器人学院教授、博士生导师,湖南大学NAIL实验室主任。主要研究方向:机器人视觉导航(SLAM)与感知技术研究。

路修远,香港科技大学博士研究生在读、湖南大学NAIL实验室访问博士生。研究方向:事件-惯性感知和导航系统

牛军凯,湖南大学NAIL实验室博士研究生在读。研究方向:SLAM

钟声,湖南大学NAIL实验室博士研究生在读。研究方向:SLAM

沈劭劼,香港科技大学电子及计算机工程系副教授、香港科技大学-大疆联合创新实验室主任。主要研究方向:机器人和无人机,状态估计、传感器融合、定位和测绘以及复杂环境中的自主导航。

原文链接

https://arxiv.org/html/2311.18189v200

近日,周易教授主持学术交流直播《探索事件相机:算法与传感器设计》,本文作者路修远、Science Robotic论文《Microsaccade-inspired Event Camera for Robotics》一作何博涛分享学术报告。点击观看直播回放:https://zmhzs.xetlk.com/sl/48QQ0c