根据用户需求,自定义需要捕捉的部位,利用NOKOV精确捕捉运动物体的位置及姿态等三维数据。

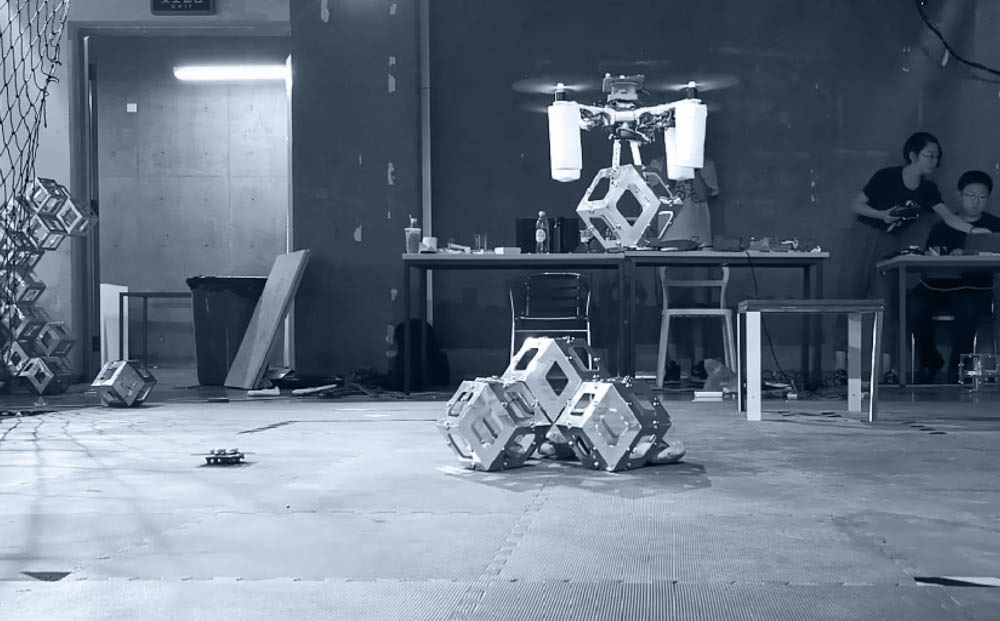

根据NOKOV实时反馈的位置信息,使出现在随机位置的多智能体,以最短路径形成理想编队队形,为其他多智能体协同控制实验提供了基础。

由于设备的可拓展性,用户可随意增减目标数量,通过在软件内对目标进行命名等操作,来完成对大批量运动体的同时捕捉。

采集三维空间XYZ坐标、六自由度(6Dof)、偏航角(Yaw)、横摇角(Roll)、俯仰角(Pitch)、欧拉角等数据,为无人机的位姿控制、运动规划提供连贯、流畅的动作数据基础。

与采用GPS、航迹推算、全局摄像头、UWB等定位方法的实验平台相比,该平台的精度大大提高,可达亚毫米级。

采集到的数据可以以VRPN形式传输,或通过SDK(C++语言)端口广播与ROS、Labview、Matlab(包含Simulink)等软件通信进行二次开发。

软件具有一键建立刚体功能,大幅提高工作效率

更多资讯:多智能体协同控制研究中光学动作捕捉与UWB定位技术比较

无人机的6DoF的数据,通过实时的方式由控制系统中飞控程序所获取,用自带的传感器数据进行LPE(Local Position Estimate)计算,用于实时更新无人机相对于全局坐标系的位置估计。之后再通过轨迹规划,协调多台无人机执行砌筑、 搬运等任务时在多个航点间的移动方式,确保在操作过程中飞行器的安全以及砌筑顺序的正确。

相关论文:同济大学建筑与城市规划学院-基于无人机的离散结构自主建造技术初探.郭喆,陆明,王祥. 建筑技艺,2019.09