西北工业大学无人系统技术研究院张通老师为第一作者的论文RMSC-VIO: Robust Multi-Stereoscopic Visual-Inertial Odometry for Local Visually Challenging Scenarios被IEEE Robotics and Automation Letters (RA-L) 录取。

引用格式

T. Zhang, J. Xu, H. Shen, R. Yang and T. Yang, "RMSC-VIO: Robust Multi-Stereoscopic Visual-Inertial Odometry for Local Visually Challenging Scenarios," in IEEE Robotics and Automation Letters, vol. 9, no. 5, pp. 4130-4137, May 2024, doi: 10.1109/LRA.2024.3377008.

准确的自我定位是机器人实现自主的基础。一些VIO算法虽然已经在公开可用的数据集上实现了高精度和稳定的状态估计,但由于仅依赖单个单目或立体摄像机,在具有挑战性的视觉环境中能力会受到限制。引入额外的传感器,或是使用多相机VIO算法,则会显著增加计算需求。

本文主要贡献

1. 提出了一种多立体VIO系统,能够集成多个立体摄像机,在视觉挑战性场景中表现出出色的鲁棒性。

2. 提出了一种自适应特征选择方法,迭代更新视觉特征的状态信息,过滤高质量的图像特征点,减少多相机系统的计算负担。

3. 提出了一种自适应的紧耦合优化方法,该方法根据不同图像特征点的质量分配优化权重,有效地提高了系统的定位精度。

4. 在各种具有挑战性的场景中进行了全面而广泛的实验评估,以验证方法的鲁棒性和有效性。目前,张通老师团队已公开这些数据集,以供未来的研究和开发使用。

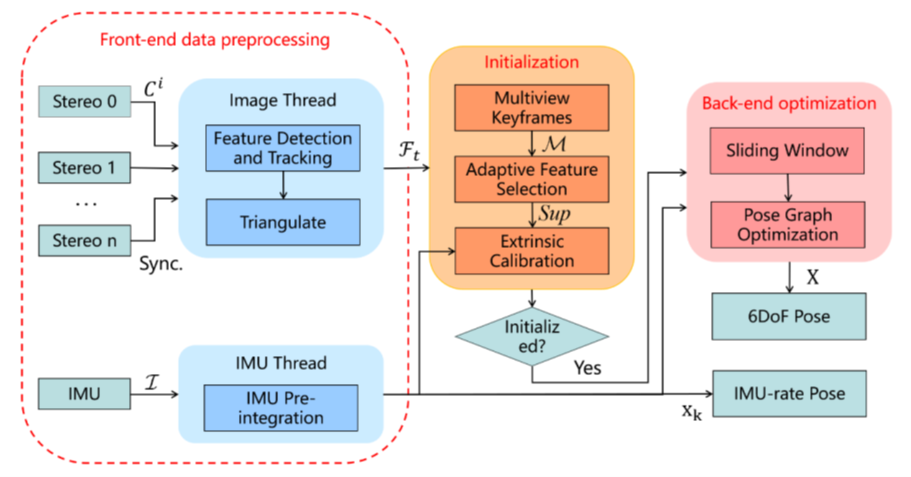

图1 RMSC-VIO系统框架流程图

前端特性处理

在多立体VIO系统中,我们从每个立体摄像机图像中提取特征点并进行匹配,以获得机器人不同方向的环境信息。

初始化

研究引入了多视图关键帧(MKF)概念,并提出了一种自适应地标特征选择方法(AFS)。

1)基于对前一帧图像的视差计算和特征点跟踪质量选择多视图关键帧。

2)当特定方向的视觉信息不可用时,AFS选择可访问的替代特征点集来初始化多视图关键帧的姿态。相反,在所有视觉信息都可访问的场景中,AFS策略性地选择一组高质量的特征点进行后续的后端优化处理。算法1给出了提出的AFS算法的伪代码。

3)为了简化多相机外设的标定,采用了多摄像机系统的在线外部校准方法。

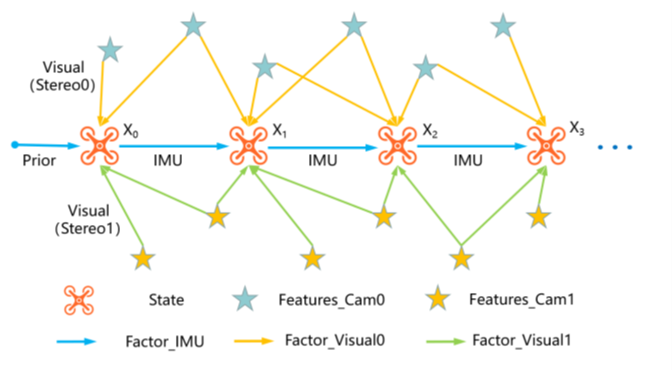

紧密耦合多立体VIO

将来自所有相机的优秀特征点集Sup集成到后端以进行联合优化。该融合方法避免了重复和复杂的VIO融合计算、减轻了多个VIO结果之间的不一致性,同时将不同角度的视觉信息整合到优化中。

图2 滑动窗口因子图的结构

多立体视觉回环检测

使用多视图闭环检测,以减少大多数序列的漂移。

研究团队收集了三个室内和四个室外场景。其中,室内序列使用NOKOV度量动作捕捉系统以亚毫米级精度获取地面真实姿势。室外序列采用实时运动学(Real-Time Kinematic, RTK)技术获得厘米级精度的地面真轨迹。

通过与最先进的算法(ORB-SLAM3、VINS-Fusion、MCVIO)的比较分析、消融实验、无人机验证,验证了系统在具有挑战性的视觉环境中的有效性和稳健性。

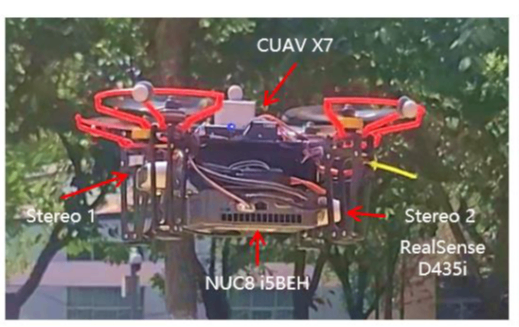

图3 实验中使用的四旋翼无人机

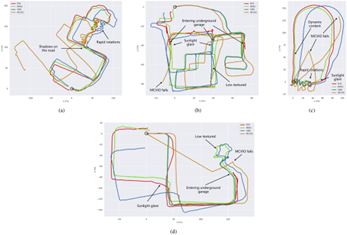

1. 在定性分析中,研究提出的RMSC-VIO算法在所有数据集上都展示了出色的轨迹性能。

![]()

图4 将 VINS-Fusion、MCVIO 和 RMSC-VIO 的估计轨迹与真实情况进行比较的四个数据集序列的俯视图。黑圈表示轨迹的起点。

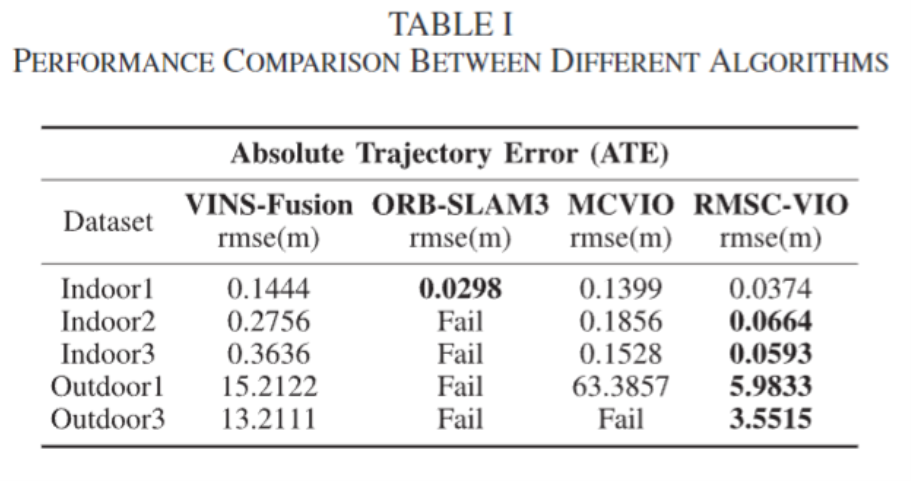

2. 在定量分析中,与VINS-Fusion相比,通过ATE测量的RMSE降低了60%到80%。此外,与MCVIO相比,RMSC-VIO方法显示出卓越的有效性,可将ATE RMSE降低60%至90%。

表1 具有完全地真值的数据序列中不同算法的绝对轨迹误差(ATE)

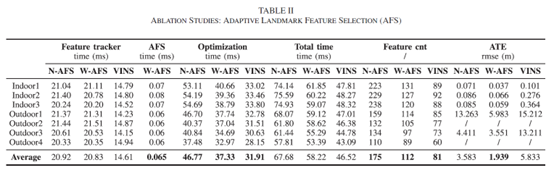

3. 通过比较AFS方法在整个VIO过程中的计算成本和对定位精度的影响来评估AFS方法的有效性。结果证明了AFS方法在相对较低的计算需求下获得高质量定位精度的有效性。

表2 N-AFS(无AFS的RMSC-VIO)、W-AFS(有AFS的RMSC-VIO)和VINS-Fusion在7个数据集上的性能总结

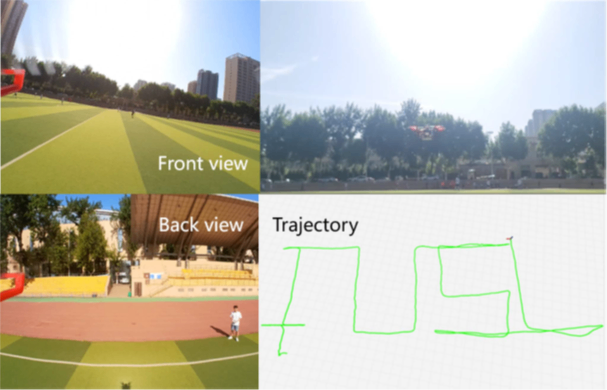

4. 通过在四轴飞行器上部署所提出的算法进行了真实飞行实验,以证明其在局部视觉挑战性场景中的实用性和有效性。

图5 在四轴飞行器上部署提出算法的真实飞行试验

研究在获取数据集时,3个室内场景序列使用了NOKOV度量动作捕捉系统。在四旋翼无人机机身粘贴反光marker点,以亚毫米级精度获取其地面真实姿势。

张通,西北工业大学无人系统技术研究院、西北工业大学智能无人机重点实验室副研究员,硕士生导师,主要研究方向为:无人系统自主感知/协同规划技术。

许建宇,西北工业大学无人系统技术研究院、西北工业大学智能无人机重点实验室硕士研究生在读,主要研究方向为:无人系统自主定位、视觉SLAM。

沈昊,西北工业大学无人系统技术研究院、西北工业大学智能无人机重点实验室硕士研究生在读,主要研究方向为:无人系统协同规划技术。

杨韬,西北工业大学无人系统技术研究院、西北工业大学智能无人机重点实验室副教授,硕士生导师,主要研究方向为:多源融合感知和导航。